L’ultima vittima del deepfake, immagini false iper-realistiche create con l’intelligenza artificiale, è Rose Villain nuda: stanno infatti girando sui social immagini pornografiche finte che ritraggono la cantante di Click Boom! nuda, e la milanese ha subito denunciato la violenza subita sui propri profili con una storia che richiama l’attenzione sull’accaduto.

Rose Villain e altre donne nude con l’Intelligenza Artificiale: la cantante denuncia la violenza

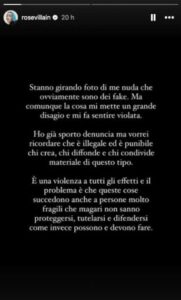

Sono tante le donne che negli ultimi anni hanno subito le pratiche del deepfake, come già Taylor Swift, Scarlett Johansson e tante altre. Rose Villain ha pubblicato una storia sul proprio profilo Instagram in cui denuncia la violenza: “Stanno girando foto di me nuda che ovviamente sono dei fake. Ma comunque la cosa mi mette a disagio e mi fa sentire violata. Ho già sporto denuncia ma vorrei ricordare che è illegale ed è punibile chi crea, chi diffonde e chi condivide materiale di questo tipo”. Continua la cantante: “E’ una violenza a tutti gli effetti e il problema è che queste cose succedono anche a persone fragili che magari non sanno proteggersi, tutelarsi e difendersi come possono e devono fare”.

Non solo Rose Villain: i rischi politici e umani dell’IA

Quella subita da Rose Villain è solo un ramo delle infinite possibilità raggiungibili con l’intelligenza artificiale, risultati anche dannosi e irrispettosi come in questo caso. La pratica del deepfake viene utilizzata sui social per simulare foto e video di personaggi famosi, intenti a dire o fare cose che ritraggono scandalo. Il deepfake fa leva sull’inganno, in quanto sono tantissime le persone portate a credere si tratti di immagini vere, causando reali problemi. È il caso di ciò che è successo poco fa in USA, dove in tanti hanno creduto a un video che provasse l’ipotetica pedofilia del presidente Joe Biden, poi ovviamente smentito.

Il deepfake, uno strumento da e per gli uomini

Il deepfake poi è campo di esistenza delle più depravate e perverse fantasie di uomini. E diciamo di uomini, e non di donne, poiché nella maggior parte dei casi il deepfake non riesce a progettare nudi maschili, ma solo donne. Sui siti di deepfake, le parole chiave più ricercate sono poi quelle dello stupro o della degradazione. I numeri dicono che il 98% dei video deepfake sono pornografici, e il 99% sono rivolti agli uomini. Non ci sono ancora leggi e norme specifiche per la pubblicazione e la diffusione di questi contenuti; c’è bisogno di aggiornarsi e fare presto di fronte alle pratiche perverse che sorgono come funghi con lo sviluppo tecnologico.